专题八:实时云渲染助力多模态数据融合:打造“全真”数字世界

2026-02-11 17:37

数字孪生的追求是构建一个“全真”的数字空间。中国信通院2025年报告将“多模态数据融合”定义为整合文本、图像、音频、视频、传感器等多源异构数据,在统一语义的孪生空间形成全真数字世界的核心技术。报告强调,高复杂度场景需要 “全维度、准实时、可交互的数据模型” 。

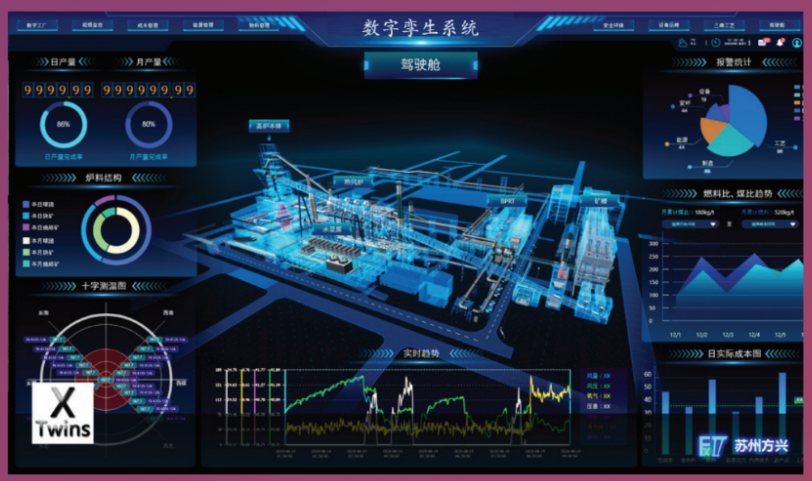

现实中的数据是割裂的:BIM模型躺在设计院的服务器里,视频监控存储在安防平台,设备传感器数据流转在时序数据库,运维工单则沉淀在ITSM系统中。这些数据格式迥异、频率不同、坐标系不统一,将它们在同一画面中有机关联并实时呈现,是巨大的工程挑战。

实时云渲染技术,正扮演着“终极合成器”的角色。它不替代专业的数据处理工具,而是在它们之上,构建一个统一的、沉浸式的呈现与交互层,让多模态数据真正“活”起来,在一个共同的三维语境中“对话”。

数字孪生的复杂性本质:多源异构数据的融合挑战

理解多模态数据融合的难度,首先要理解其面对的“多”与“异”。

模态之多:涵盖 “文、图、音、视、物” 。文本:设计说明书、运维规程、故障日志。图像:设计图纸、现场照片、遥感影像。音频:设备运行异响录音、应急广播。视频:实时监控流、无人机巡检画面。传感器数据:温度、压力、位移、电流等时序流数据。

异构之困:这些数据在格式、频率、坐标系和语义上完全不同。一个温度传感器每秒上报一个数值(时序点),一个监控摄像头每秒产生25帧图像(二维栅格流),而BIM模型是一个静态的三维矢量结构。需要将每秒的温度数值,实时标注在BIM中对应的设备模型上并将监控视频的画面,精准贴图到三维场景中虚拟摄像机的视角平面上。

实时之难:许多应用场景要求“准实时”融合。例如,在智慧工地,塔吊防碰撞系统需要将多个塔吊的实时角度传感器数据、吊钩视频数据,与BIM中的三维模型位置进行毫秒级融合计算与可视化,才能发出及时预警。延迟意味着风险。

实时云渲染作为融合呈现层:统一时空框架下的数据调度与渲染

实时云渲染解决多模态融合的思路,是采用分层架构,各司其职,最终在渲染层汇总。

数据处理层:各专业系统(物联网平台、视频分析平台、GIS平台、BIM平台)负责处理自己擅长的数据。例如,视频分析平台识别出监控画面中的人员并输出其二维像素坐标;GIS平台将无人机航拍的正射影像进行地理配准。

语义关联与坐标转换层:这是一个关键中间层,通过数据中台或融合引擎完成。它的核心任务是建立跨模态数据的语义关联(例如,将“3号水泵”这个文本标签,与BIM中的水泵模型、物联网中的水泵传感器ID、视频中对应的摄像头ID关联起来),并进行坐标系统一转换(将视频分析得到的二维像素坐标,通过相机标定参数,转换为与BIM一致的三维世界坐标)。

实时云渲染呈现层:平行云LarkXR平台位于这一顶层。它通过API接收来自融合引擎的“指令包”:包括需要渲染的三维场景、在特定位置(三维坐标)显示的视频流纹理、需要动态更新的设备状态数值标签、需要高亮显示的告警区域等。LarkXR的渲染引擎将这些多模态信息在同一帧画面中进行合成、渲染,并通过流化技术推送到终端。

实时云渲染LarkXR平台的技术实现:容器化集成与API打通

LarkXR平台实现强大融合能力,依赖于其开放和可扩展的架构。

容器化部署与微服务集成:LarkXR本身可以容器化部署,可以将视频流处理服务、轻量化的GIS服务、数据驱动逻辑等,也封装为容器化的微服务,与LarkXR渲染服务部署在同一个集群中。服务间通过内部高速网络通信,极大降低了数据交换延迟,实现了紧密的“边缘融合渲染”。

丰富的API与数据驱动:LarkXR提供丰富的API接口及SDK,允许外部系统深度控制渲染场景。例如,物联网平台可以调用API,实时更新场景中某个设备模型的旋转角度;视频平台可以推送流地址和对应的三维投影矩阵,让LarkXR将视频作为动态纹理贴在三维模型的“屏幕”上。万间科技在构建OurBIM平台时,正是利用了LarkXR的API,实现了BIM模型与实时数据的深度融合。

统一的状态管理与事件响应:平台可以维护一个统一的状态机。当传感器数据触发一个告警事件时,状态机更新。LarkXR根据状态变化,自动执行一系列渲染指令:播放告警音效、在三维设备上闪烁红光、在侧边栏弹出相关维修工单文本。这使得多模态数据不再是简单叠加,而是产生了基于语义的联动反应。

典型场景:智慧园区管理中的多模态融合实战

以一个智慧园区综合管理为例,看LarkXR如何融合多模态数据:

基础场景:加载园区的实景三维模型与BIM模型作为底图。

视频融合:接入所有摄像头视频流。当用户点击三维场景中的某个虚拟摄像头模型,其对应的实时视频画面会以画中画形式,或直接投射到该摄像头模型的视野锥范围内显示,实现“点击即看”。

IoT数据叠加:所有楼宇的能耗数据、会议室占用状态、车位信息,以动态数字标签或彩色热力图的形式,实时叠加在对应的建筑、房间、车位上。鼠标悬停可显示详细历史曲线。

事件关联:当周界入侵系统(基于视频分析)产生告警,三维场景会自动切换视角至告警区域,对应的摄像头视频被突出显示,并在地图上绘制入侵者的预测运动轨迹(基于多帧分析)。同时,预案系统自动关联弹出该区域的安保人员名单和应急处置文本流程。

协同处置:指挥中心人员可以在三维场景中直接绘制布控区域,下达语音指令。这些指令和标注会实时同步到现场保安的AR眼镜或手机终端上,指导其行动。

在这个场景中,用户面对的不再是分散的十几个软件界面,而是一个统一的、信息完备的 “作战沙盘” 。所有决策都基于对多维度信息的综合掌控。这正符合中国信通院报告所指:多模态融合旨在形成 “语义更丰富的全真世界”。

平行云LarkXR通过将渲染能力云化、服务化、API化,使得构建这样一个复杂的融合应用不再需要从零开发庞大的图形引擎,而是可以像搭积木一样,集成各领域最佳实践,快速构建出面向不同行业的“全真”数字孪生交互门户,让数据融合真正服务于洞察与决策。

_1773392345701.png)